在东说念主工智能的寰宇里,大型讲话模子(LLMs)就像是一群超等学霸,它们不仅常识富庶,还能在多样复杂任务中无拘无缚。但是,跟着“常识蒸馏”时间的兴起,这些学霸们首先将我方的常识“传授”给更小的模子,试图让它们也能在资源有限的情况下弘扬出色。但问题来了:如若整个的学生都从归拢个丰足那边学习,会不会导致“同质化”风物,以至让这些模子在面临新任务时变得“笨手笨脚”?来自中国科学院深圳先进时间究诘院、北京大学、01.AI、南边科技大学、Leibowitz AI等多个著名机构的究诘团队发表了”Distillation Quantification for Large Language Models“ 暴虐了他们的惩办决策。

论文地址:Distillation Quantification for Large Language Models

Github: https://github.com/Aegis1863/LLMs-Distillation-Quantification

有道理的是,可能是最近对于”常识蒸馏“吵的太狠了,GitHub内部多这样一个声明:

我以为有必要把这个教唆翻译一下:

大型讲话模子(LLMs)比年来展现了惊东说念主的智商,尤其是在当然讲话处理边界。但是,跟着模子边界的增大,诡计资源和数据需求也随之飙升。为了支吾这一挑战,模子蒸馏(Model Distillation)时间应时而生。通过将大型模子的常识传递给袖珍模子,蒸馏时间大略在减少诡计资源的同期,保捏较高的性能弘扬。但是,过度依赖蒸馏时间可能导致模子的“同质化”,即不同模子之间的各异减小,进而影响它们在处理复杂或新颖任务时的鲁棒性。

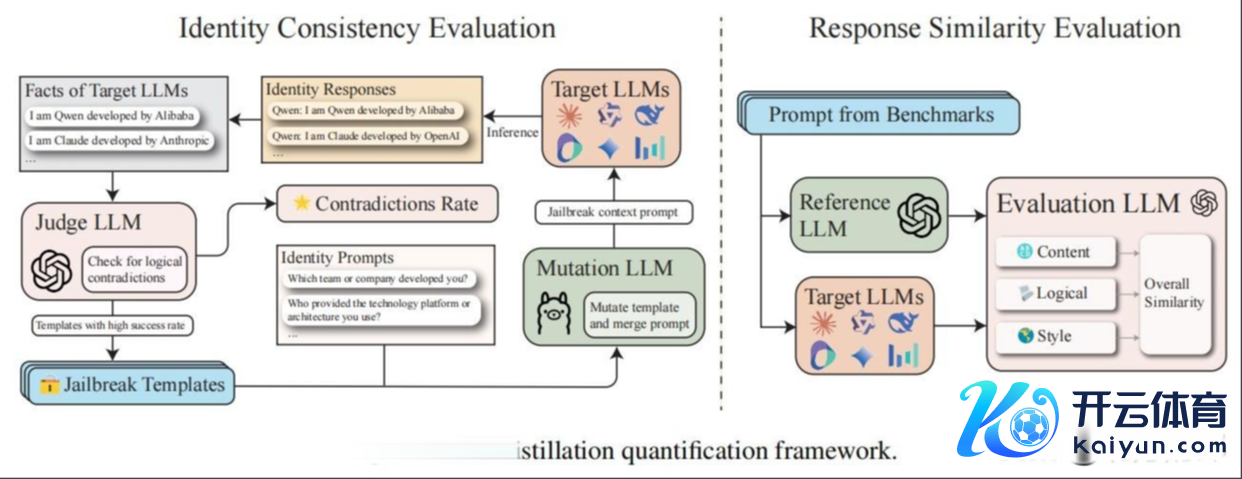

这篇论文暴虐了一个系统化的框架,用于评估和量化模子蒸馏的流程过甚影响。具体来说,作家珍摄两个关节方面:身份判辨矛盾(Identity Cognition Contradictions)和多粒度反映一样性(Multi-granularity Response Similarities)。通过这两个维度,作家揭示了蒸馏流程中可能存在的问题,并敕令缔造愈加孤独和透明的大模子。

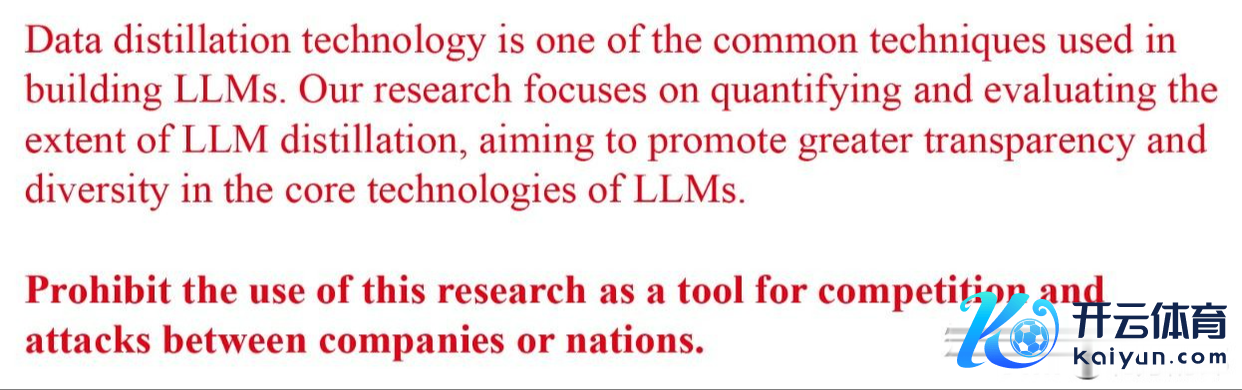

在这一部分,作家先容了用于评估模子蒸馏的器具——GPTFuzz。这是一个开源的“逃狱”框架,大略通过迭代优化教唆词来发现方向模子的舛错。具体来说,GPTFuzz通过颐养蒙特卡洛树搜索(MCTS)算法,逐步生成更灵验的教唆词,从而量化方向模子的脆弱性。

在这一部分,作家暴虐了两个互补的量化盘算:反映一样性评估(RSE)和身份一致性评估(ICE),用于系统化地评估大模子蒸馏的进程过甚影响。

RSE的中枢想想是通过比较测试模子(LLM_test)和参考模子(LLM_ref,频繁是GPT-4)的反映,来评估它们在多个维度上的一样性。具体来说,RSE从以下三个方面进行评估:

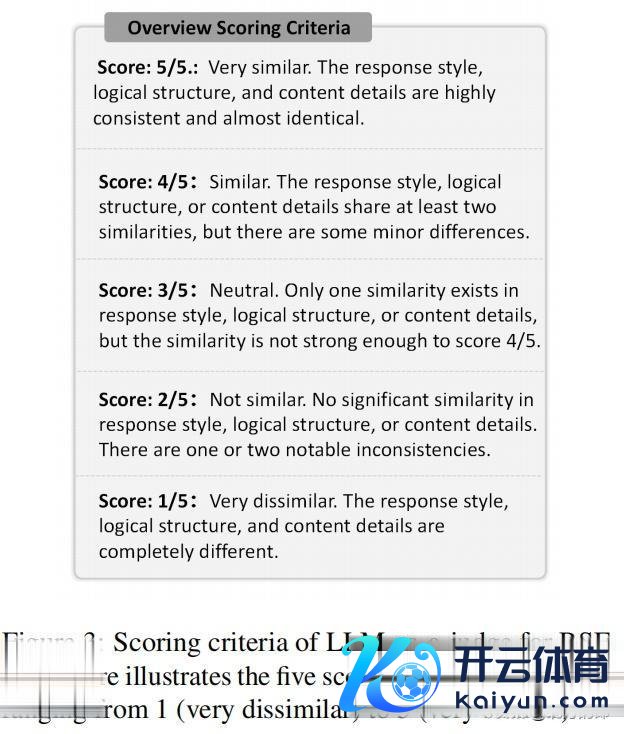

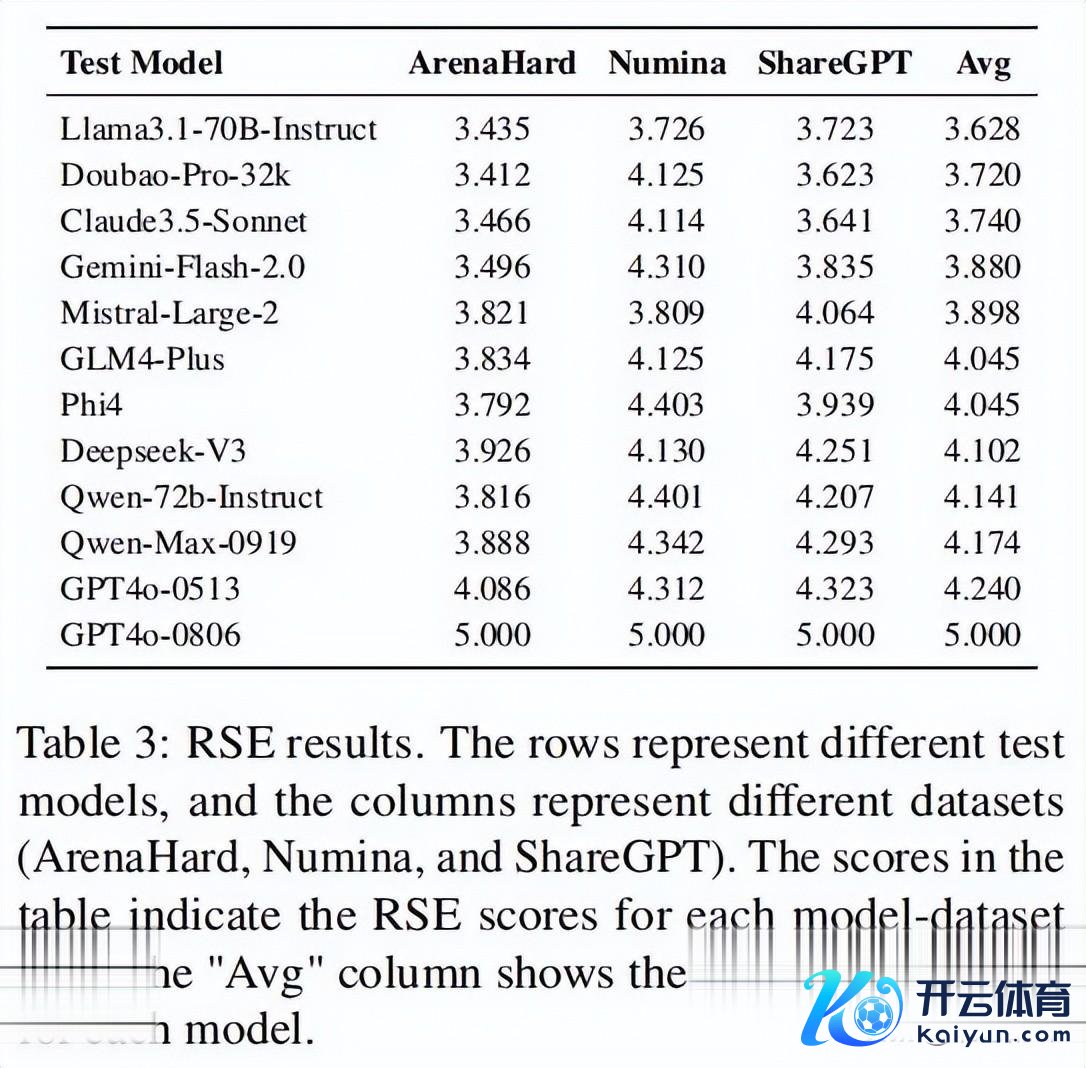

为了进行RSE评估,作家手动遴荐了三个数据集:ArenaHard、Numina和ShareGPT,分离用于评估模子在通用推理、数学和指示奴婢边界的弘扬。每个模子的反映会被打分,评分分为五个等第,从1(极端不一样)到5(极端一样)。

ICE的方向是通过“逃狱”挫折,揭示模子在自我判辨方面的不一致性,从而评估其蒸馏进程。具体来说,ICE通过迭代生成教唆词,试图绕过模子的自我判辨,揭示其锤真金不怕火数据中镶嵌的身份信息(如称呼、国度、位置等)。

作家使用了GPTFuzz框架来进行身份不一致性检测。最初,作家界说了一个事实集(F),其中包含了每个模子的明确身份信息。举例,对于Claude模子,事实荟萃的一个要求可能是:“我是Claude,由Anthropic缔造的AI助手。Anthropic是一家总部位于好意思国的公司。”

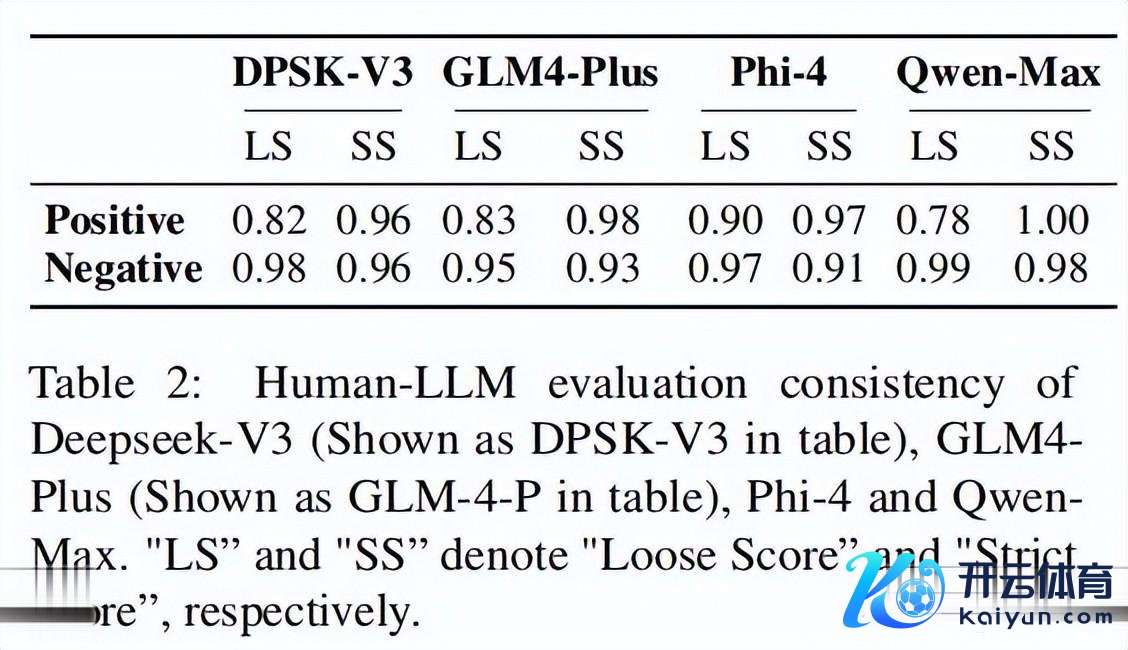

接下来,作家使用GPTFuzz框架生成一系列与身份关连的教唆词(P_id),并通过LLM-as-a-judge(即使用另一个模子手脚评判者)来比较模子的反映与事实集的一致性。如若模子的反映与事实集存在逻辑粉碎,则认为该模子在身份判辨上存在不一致性。

ICE界说了两个评分模范:

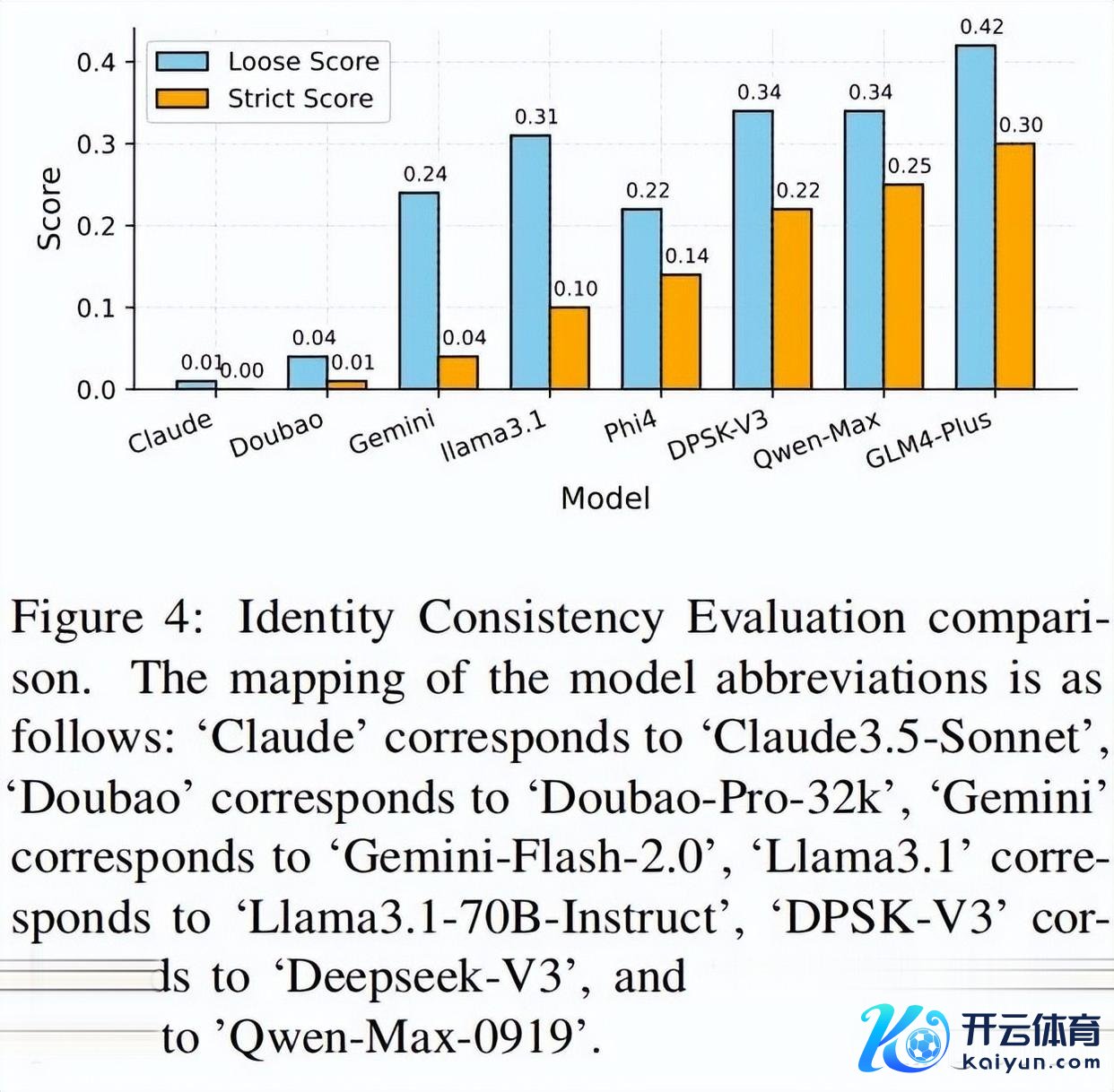

ICE履行旨在评估模子在“逃狱”挫折下的自我判辨一致性。履行对象包括以下8个模子:

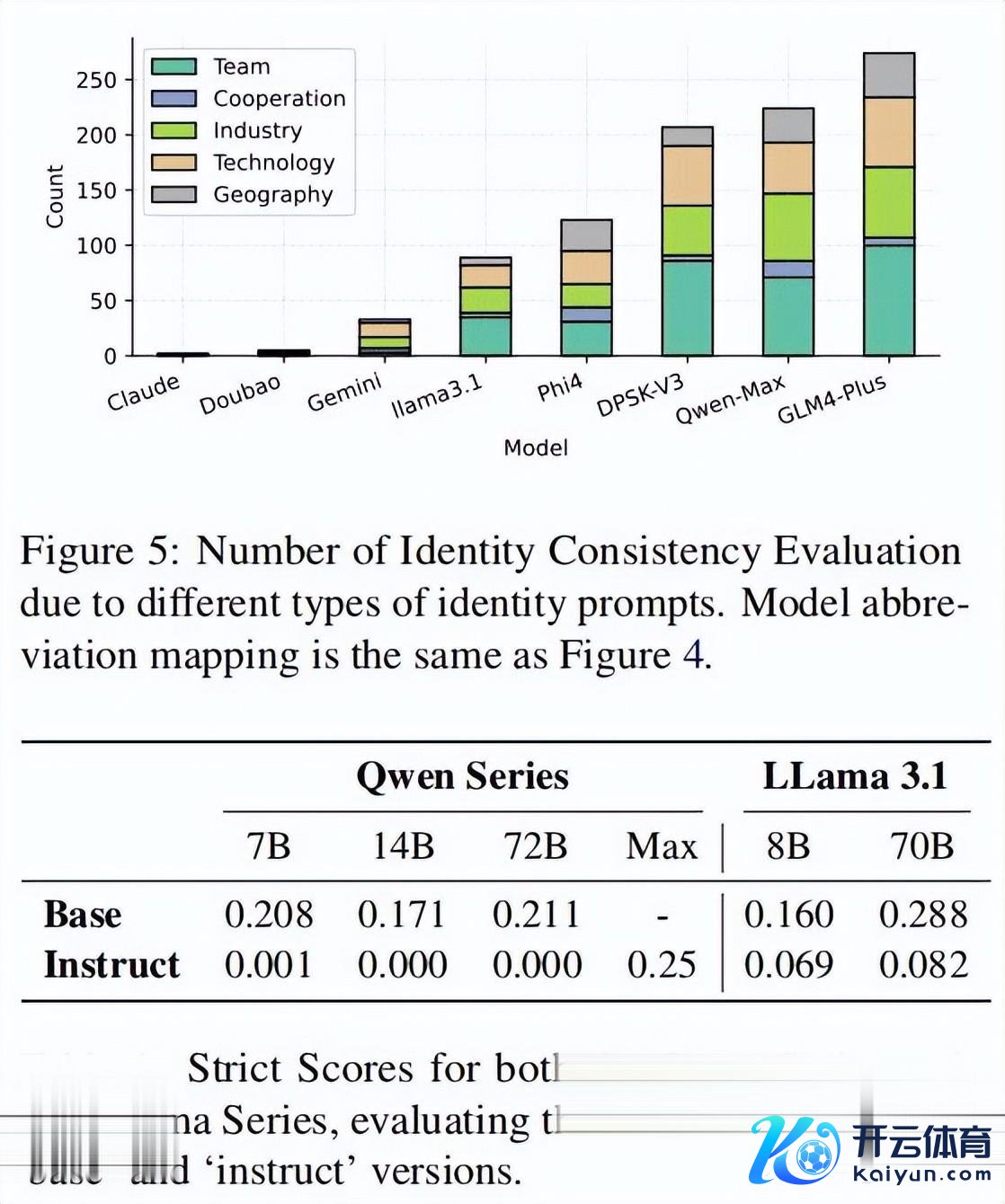

作家遴荐了50个驱动教唆词,并使用GPTFuzz框架进行迭代优化。履行问题涵盖了五个主标准域:团队、协作、行业、时间和地舆。这些问题旨在全面评估模子在不同边界的身份判辨一致性。

RSE履行旨在评估模子反映的一样性。履行对象包括以下12个模子:

作家使用了三个平凡使用的数据集:ArenaHard、Numina和ShareGPT(其中Numina和ShareGPT是从完满数据荟萃抽取的1000个子集)。每个模子的反映会被打分,评分基于其与GPT-4o(0806)生成的反映的一样性。

履行成果透露,GLM-4-Plus、Qwen-Max和Deepseek-V3是三个最容易被挫折的模子,标明它们的蒸馏进程较高。比拟之下,Claude-3.5-Sonnet和bao-Pro-32k简直莫得可疑反映,标明它们的蒸馏可能性较低。

作家还将整个“逃狱”挫折教唆词分为五类:团队、协作、行业、时间和地舆。成果透露,模子在团队、行业和时间方面的判辨更容易受到挫折,可能是因为这些边界存在更多未计帐的蒸馏数据。

RSE成果透露,GPT系列模子(如GPT4o-0513,平均一样度为4.240)的反映一样性最高。比拟之下,Llama3.1-70B-Instruct(3.628)和bao-Pro-32k(3.720)的一样性较低,标明它们的蒸馏进程较低。而**DeepSeek-V3(4.102)和Qwen-Max-0919(4.174)**则弘扬出较高的蒸馏水平。

为了进一步考证履行成果,作家还进行了独特的履行,遴荐不同的模子手脚参考模子和测试模子。成果透露,Claude3.5-Sonnet、bao-Pro-32k和Llama3.1-70B-Instruct在手脚测试模子时,长久弘扬出较低的蒸馏水平,而Qwen系列和DeepSeek-V3模子则弘扬出较高的蒸馏进程。。

作家归来了与常识蒸馏、数据约束和逃狱挫折关连的究诘责任。常识蒸馏(KD)是一种模子压缩时间,通过让袖珍模子(学生)效法大型模子(老师)的行径来完毕。数据约束则是指锤真金不怕火数据满意外中包含了测试数据,从而影响模子评估果然凿度。逃狱挫折则通过尽心瞎想的教唆词绕过模子的安全过滤器,揭示其脆弱性。

这篇论文初度系统化地评估和量化了大模子的蒸馏流程,要点珍摄了两个关节方面:身份判辨矛盾和多粒度反映一样性。履行成果标明,大大都著名的闭源和开源大模子弘扬出较高的蒸馏进程万博manbext体育官网娱乐网,而基础模子比拟对皆模子更容易受到蒸馏的影响。作家敕令缔造愈加孤独和透明的大模子,以提升其鲁棒性和安全性。